삼성전자, 차세대 반도체 솔루션 주도… AI 시대 초연결 경험 강화

삼성전자는 연구개발(R&D), 전략적 시설투자 등 지속 성장을 위한 기반을 강화해 왔다고 30일 밝혔다.

삼성전자 DX부문은 삼성 AI를 통해 개인화된 디바이스 인텔리전스를 추진, 모든 디바이스에 AI를 본격적으로 적용해 소비자에게 생성형 AI와 온디바이스 AI가 펼쳐갈 새로운 경험을 제공한다는 방침이다. ▲스마트폰, 폴더블, 액세서리, XR 등 갤럭시 전제품에 AI 적용을 확대하고 ▲차세대 스크린 경험을 위해 AI 기반 화질·음질 고도화, 한 차원 높은 개인화된 콘텐츠 추천 등을 전개해 가며 ▲올인원 세탁·건조기 비스포크 AI 콤보를 통해 일반 가전제품을 지능형 홈가전으로 업그레이드한다.

또한, 삼성전자는 전사적 AI 역량을 고도화해 차세대 전장, 로봇, 디지털 헬스 등 신사업을 육성한다.

삼성전자 DS부문은 V낸드, 로직 FinFET, GAA 등 초일류 기술을 통해 미세화의 한계를 극복하고 업계 내 독보적 경쟁력을 갖춰왔다. 2030년까지 기흥 R&D 단지에 20조원을 투입한다. 반도체연구소는 양적·질적 측면에서 두배로 키운다. 연구 인력과 R&D 웨이퍼 투입을 지속적으로 늘려 첨단 기술 개발의 결과가 양산 제품에 빠르게 적용되도록 할 계획이다. R&D 투자를 통해 얻은 기술 우위를 바탕으로 효율적인 투자 및 체질 개선 활동을 강화하고, 이를 통해 확보된 재원을 연구개발에 재투자해 성장 기반을 강화하는 선순환구조를 구축해 간다는 계획이다.

삼성전자는 반도체 사업에서 고성능·첨단공정 제품 판매 및 다양한 응용처의 신규 수주를 지속적으로 확대해 기술 경쟁력과 시장 리더십을 더욱 공고히 할 방침이다.

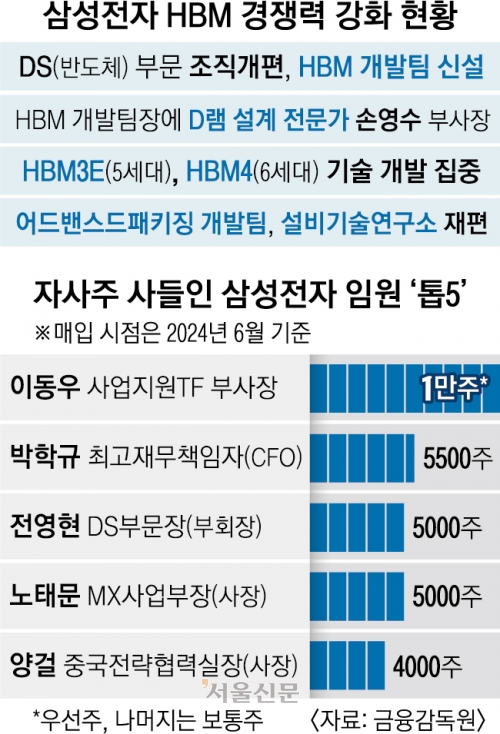

메모리는 업계 최고 수준의 생산능력을 기반으로 HBM3, HBM3E 비중을 확대해 고성능·고대역폭 수요에 적극 대응할 계획이다. 시스템LSI는 플래그십 제품 판매 비중을 확대하고, 모바일 시장 외 사업영역을 넓혀 견고한 사업구조를 갖춰 나간다. 파운드리는 GAA(Gate-All-Around) 3나노 2세대 공정 양산과 테일러 공장 가동을 통해 기술 경쟁력을 더욱 강화하고 고성능컴퓨팅, 차량, 소비자용 등 다양한 응용처로 수주를 확대해 간다.

삼성전자 관계자는 “초거대 AI 시대에 메모리 기술의 발전과 성능 향상이 중요하다. 삼성전자는 지난 40년간 업계를 선도하며 쌓아온 독보적인 기술 노하우를 바탕으로 AI 반도체 생태계를 확장할 다양한 메모리 제품을 준비해 왔다”면서 “이런 첨단 메모리 및 서버 시장의 수요 증가에 대응하기 위해 AI 시대에 최적화된 다양한 차세대 메모리 솔루션을 개발하며 메모리 패러다임의 변화를 주도하고 있다”고 말했다.

삼성전자는 2016년 세계 최초로 고성능 컴퓨팅(HPC)용 HBM 사업화를 시작하며, AI용 메모리 시장을 본격적으로 개척했다. 2017년 선보인 8단 적층 HBM2는 당시 가장 빠른 속도의 메모리였던 GDDR5 대비 8배 빠른 속도를 구현했고, 이 제품을 통해 AI·HPC 시대에 필수적인 3차원 스택 기술을 선보일 수 있었다.

이후에도 삼성전자는 고객과 밀접히 협업하여 AI·HPC 생태계를 견인하고 있다. HBM2 제품을 거쳐 HBM2E, HBM3를 양산하고 있으며, 9.8Gbps 속도의 HBM3E 제품을 개발해 고객사에 샘플 공급 예정이다. HBM4는 2025년을 목표로 개발 중으로, 해당 제품에 적용하기 위해 고온 열특성에 최적화된 기술도 준비하고 있다.

![[재테크+] ‘5만 전자’ 삼성의 운명…“주가는 엔비디아 손에 달렸다”](https://img.seoul.co.kr/img/upload/2025/01/14/SSC_20250114164627_V.jpg)

![“엄청난 수요” 한마디에 AI 여름?…차세대 칩 ‘블랙웰’에 울고 웃다[딥앤이지테크]](https://img.seoul.co.kr/img/upload/2024/06/05/SSC_20240605182943_V.jpg)